Foto’s hebben lang gegolden als bewijs. Eén beeld zegt meer dan duizend woorden, toch? Maar in 2025 is dat beeld vaak helemaal niet meer zo betrouwbaar. Ik merk het in mijn werk, maar ook in mijn omgeving: we vertrouwen onze ogen, terwijl onze ogen steeds vaker voor de gek worden gehouden. Hieronder geef ik je vijf redenen waarom je foto’s niet meer zomaar kunt vertrouwen.

1. AI maakt nepbeelden die echt lijken

Met tools als Midjourney, DALL·E en Stable Diffusion kan ik in een paar seconden een foto maken van een persoon die niet bestaat, een gebeurtenis die nooit heeft plaatsgevonden of een situatie die volledig verzonnen is. De kwaliteit is zo hoog geworden dat het verschil met een echte foto nauwelijks nog te zien is. Zelfs de belichting, schaduwen en reflecties worden slim nagebootst.

Hieronder zie je vier afbeeldingen. Eén daarvan is echt. Zie jij welke echt is? Het antwoord staat onderaan dit artikel.

2. Iedereen kan nu foto’s aanpassen

Vroeger had je dure software en veel ervaring nodig om een foto goed te bewerken. Nu niet meer. Met alleen een gratis ChatGPT-account kun je al AI-tools gebruiken die gezichten aanpassen, objecten weghalen of achtergronden veranderen. Ook met een basisabonnement op Photoshop heb je toegang tot slimme functies die automatisch dingen invullen of verplaatsen.

Het is nog niet zo dat je met één druk op de knop een perfecte nep-foto maakt. Maar we komen dichtbij. De drempel wordt lager, de kwaliteit hoger – en daarmee wordt het steeds lastiger om echt van nep te onderscheiden.

Hieronder zie je twee voorbeelden. Het voorbeeld links is van Midjourney V1 uit 2022. De afbeelding rechts is van Midjourney V7, drie jaar later.

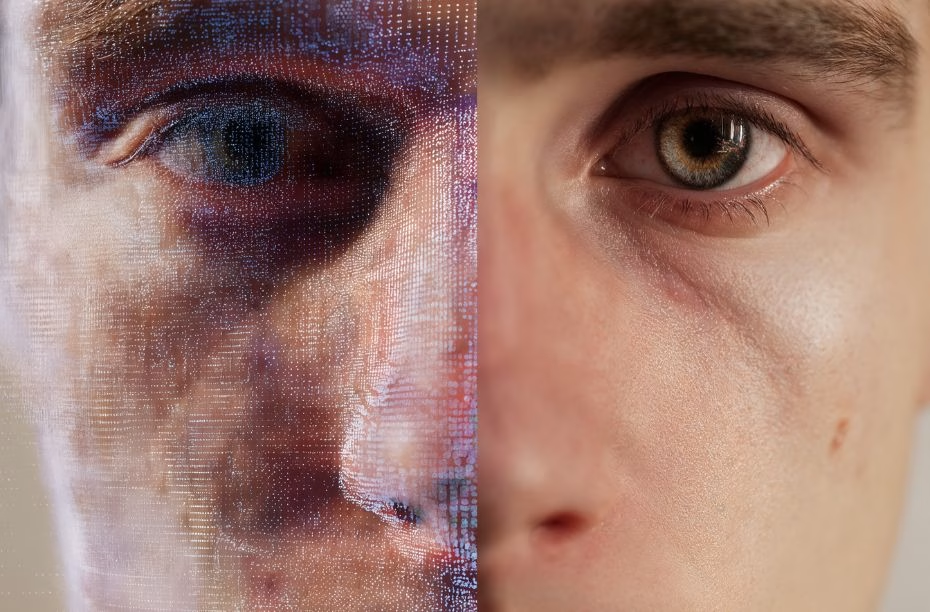

3. Deepfakes en gezichtsvervanging zijn makkelijker dan je denkt

AI kan tegenwoordig gezichten vervangen in bestaande foto’s met een paar simpele handelingen. Iemand kan worden afgebeeld in een situatie waarin hij nooit is geweest. Een glimlach wordt toegevoegd, een blik wordt veranderd, of een gezicht wordt geplakt op een lichaam van iemand anders. Het resultaat ziet eruit alsof het echt is gebeurd.

Zelfs je eigen foto’s zijn kwetsbaarder dan je zelf misschien denkt. Eén upload op internet is voldoende. Een afbeelding kan worden opgeslagen, aangepast en opnieuw verspreid – met jouw gezicht in een compleet ander verhaal. En het hoeft niet eens veel moeite te kosten. Er zijn steeds meer (gratis) tools beschikbaar waarmee dit snel en overtuigend kan. Daarom is het verstandig om goed na te denken over wat je deelt, en op welke plek je dat doet.

4. Oude foto’s krijgen een nieuw leven – met of zonder aanpassing

Ik zie het steeds vaker gebeuren: een foto uit 2015 wordt opnieuw gedeeld alsof hij gisteren is genomen. Bijvoorbeeld bij natuurrampen, oorlogen of rellen. De foto is echt, maar de context niet. En dat is soms al genoeg om mensen te misleiden.

Wat het nog gevaarlijker maakt, is dat een kleine bewerking met AI al voor nóg meer verwarring zorgt. Denk aan een andere kleur lucht, wat extra rook, een vlag die is toegevoegd. Soms is zelfs dat niet eens nodig: het beeld lijkt te kloppen met wat we verwachten, dus we nemen het aan als waar. Juist die combinatie van een geloofwaardig beeld en een vals verhaal is enorm krachtig.

5. We willen dat beelden kloppen met ons gevoel

Misschien wel de belangrijkste reden: we zíén wat we wíllen zien. Een indringende foto die past bij ons wereldbeeld wordt sneller geloofd en gedeeld, zelfs als hij nep is. Dat maakt het gevaarlijk. Beelden bevestigen onze aannames en worden zelden gecontroleerd voordat ze viraal gaan.

Oplossing bij punt 1: De man linksonder (derde foto) is echt. De rest heb ik zelf met AI gemaakt.